당신의 AI,

당신의 머신,

당신의 규칙

MacBook에서 DGX Spark까지, 당신의 하드웨어가 가진 잠재력을 온전히 깨우세요.

로컬 인퍼런스부터 에이전트 관리, 자원 클러스터링까지.

단 하나의 앱으로 무한한 가능성을 엽니다.

무료 · 계정 불필요 · 데이터는 내 컴퓨터에만

완벽한 AI 오케스트레이션

Backend.AI GO는 당신의 필요에 맞춰 확장됩니다.

로컬 인퍼런스 엔진

Windows, macOS, Linux, 그리고 DGX Spark와 같은 개인용 워크스테이션에서 llama.cpp 등을 네이티브로 실행하세요. CUDA, ROCm, Metal, Intel Arc 가속을 지원합니다.

개인용 AI 에이전트

채팅, 이미지 생성 기능이 내장되어 있으며, Tool Calling 및 MCP(Model Context Protocol)를 통해 개인적인 작업을 안전하게 수행하는 에이전트를 제공합니다.

P2P 클러스터링

최대 32대의 Backend.AI GO 인스턴스를 연결하여 개인용 컴퓨팅 클러스터를 구축하거나, 엔터프라이즈 Backend.AI 클러스터에 연동할 수 있습니다.

클라우드 & 원격 모델 통합

OpenAI, Anthropic, Gemini를 매끄럽게 통합하거나, 원격 vLLM/Ollama 서버를 마치 로컬 자원처럼 연결하여 사용할 수 있습니다.

보안 & 프라이버시

데이터는 당신의 소유입니다. 민감한 워크로드를 외부 유출 없이 로컬 인프라 안에서 안전하게 실행하세요.

서비스 라우터

로컬, 클러스터, 클라우드의 모든 AI 자원을 단일하고 통일된 API 엔드포인트로 노출하여 서비스 라우터로 활용할 수 있습니다.

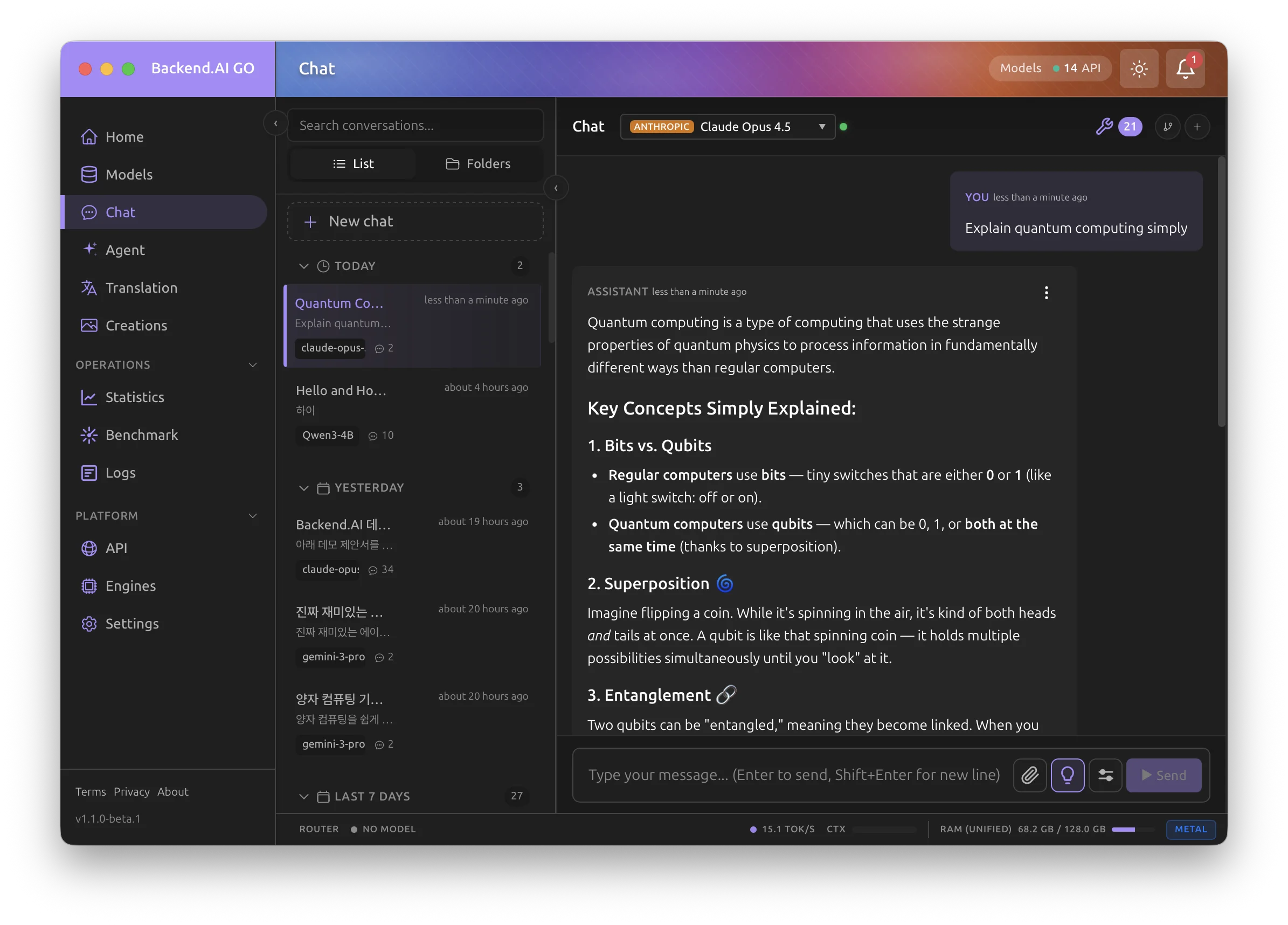

직접 확인하세요

로컬 AI를 위한 모던 인터페이스.

다운로드

최신 버전 v1.3.0

한 줄 명령어로 설치

macOS Apple Silicon

Homebrew가 필요합니다. 안정 버전이 릴리스될 때마다 자동으로 업데이트됩니다.

Backend.AI GO Enterprise

조직을 위한 에디션

폐쇄망 모델 및 소프트웨어 업데이트 서버, 자사 브랜드 반영 커스텀 빌드, 기관 내 통합 라우팅, Backend.AI Enterprise 클러스터 연동을 통한 대규모 AI 모델 중앙 운영을 지원합니다. PALI suite 형태로도 제공됩니다.

문의하기